ClaudeでCO-STARの味を覚えた翌週、同じプロンプトをそのままChatGPTに投げてみた。返ってきた文章を読んで、正直こう思った。「いや、マジメすぎない?」

XMLタグ(<context> <tone>)で仕切ったCO-STARをChatGPTに渡すと、出力はたしかに崩れない。崩れないが、妙に教科書的で、遊びがない。Claudeが出してくれた「ちょっと肌感のある文章」がまるごと消えて、模範解答みたいな文面だけが返ってくる。

最初は「CO-STARがChatGPTには合わないのかもしれない」と疑った。でも違った。合わないのはCO-STARじゃなくて、XMLタグという渡し方の方だった。

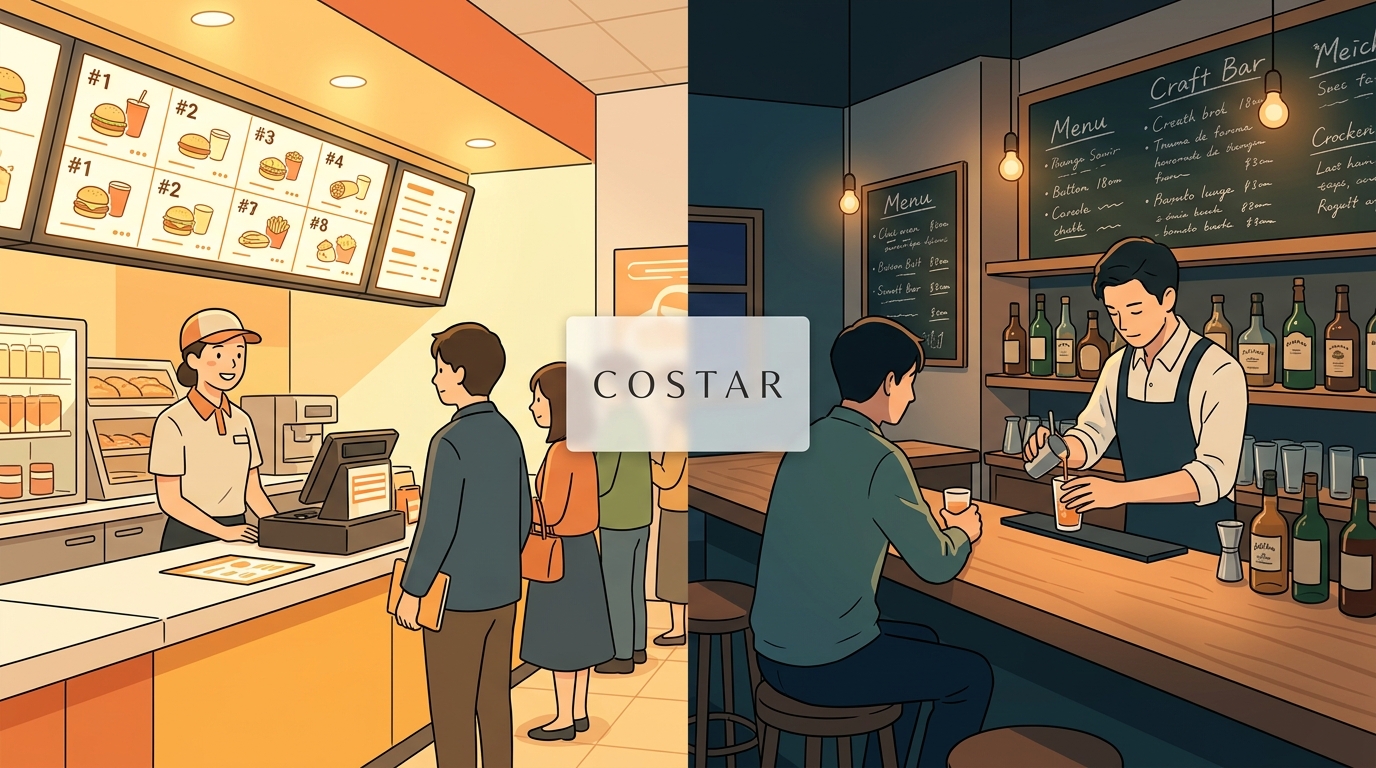

分かりやすいたとえをひとつ。ChatGPTはチェーン店の店員だ。メニュー番号で頼めば、全国どこで頼んでも同じ味で正確に出してくれる。ただしカウンターで「今日の気分に合うやつ適当に」と頼んでも、微笑んで定食セットを持ってくる。一方のClaudeはこだわりバルのマスターで、空気で察するタイプ。この違いを理解しないまま両者に同じプロンプトを投げると、片方の実力を半分も引き出せない。

この記事では、ChatGPT(GPT-4o)でCO-STARを3パターン実測した結果から、ChatGPT向けの最適なCO-STARの渡し方と、Claudeとの使い分け指針を整理する。

3行まとめ

- ChatGPTでもCO-STARは効く。ただしXMLタグではなくMarkdown見出し(

# Context)で仕切るのが一番効く- ChatGPTは「指示通りに正確に動くチェーン店型」、Claudeは「空気を読んで創作するバル型」。CO-STARはどちらにも使えるが、出てくる文章の”顔”が違う

- 使い分けは「再現性重視=ChatGPT」「表現の幅重視=Claude」。これを覚えるだけで両AIの実力を引き出せる

結論先出し:ChatGPTにCO-STARは効く。ただし”効き方”がまじめすぎる

先に答えから言う。ChatGPTにCO-STARは効く。 6要素(Context / Objective / Style / Tone / Audience / Response)を書いて渡せば、書かずに投げるよりも圧倒的に精度が上がる。ここまではClaudeと同じだ。

違うのはここから先。

ChatGPTのCO-STAR出力は、「指示された要素を全部正確に反映しつつ、冒険はしない」という顔をしている。Tone に「プロフェッショナルかつ親しみやすい」と書けば、そのど真ん中を狙った文章が返ってくる。Claudeのように「親しみやすさを残しつつ、ちょっと不器用な体温まで混ぜる」みたいな加減はしない。指示された中点を、毎回きっちり叩く。

これはバグじゃない。ChatGPTの設計思想がそうなっていると理解したほうが早い。OpenAIは RLHF(人間のフィードバックによる強化学習)を初期からヘビーに回していて、「指示への忠実さ」をモデルの一番の価値にしてきた。OpenAIのプロンプトガイド完全版 でも書いたが、ChatGPT攻略の基本は「指示を具体化して積み上げる」こと。CO-STARはその積み方を型化したフォーマットなので、ChatGPTとは相性が良すぎるくらいだ。

ただしその相性の良さが、裏を返すと「遊びのなさ」になる。CO-STARの6要素に書いていないものは、ChatGPTは基本的に出してこない。Claudeなら「Tone」から連想してちょっと気の利いた一文を勝手に足してくることがあるが、ChatGPTはやらない。チェーン店の店員が、注文されていないトッピングを勝手に載せないのと同じだ。

つまりChatGPTでCO-STARを使うときの心構えは、「自分が欲しいものは全部6要素に書け」。書き忘れたら、空欄のまま出てくる。

実測Before/After ― 3パターンで精度はこう変わる

理屈だけだと信じてもらえないので、同一タスクで3パターン実測した結果を出す。

タスクは 「フリーランスのWebデザイナーが、新規クライアントへ送る初回提案メール」 を書かせるもの。モデルは ChatGPT(GPT-4o、2026年4月時点)。

パターン1:CO-STARなし(ベタ指示)

Webデザイナーのフリーランスです。

新規クライアント(中小企業のEC事業部長)に、

リニューアル提案のメールを書いてください。

親しみやすく、でもプロっぽく。

返ってきた文章(冒頭抜粋):

○○株式会社 EC事業部

○○様はじめまして。フリーランスでWebデザインをしております△△と申します。

このたびは貴社ECサイトのリニューアルに関してご提案の機会をいただき、誠にありがとうございます。

貴社の益々のご発展を心よりお祈り申し上げます。…

典型的なAI生成メール文面。「親しみやすく、でもプロっぽく」の指示は形だけ反映されていて、冒頭挨拶は完全にビジネステンプレ。どこのフリーランスが書いても成り立つ、匿名的なメールが出てきた。

パターン2:CO-STAR + Markdown見出し

以下のCO-STAR指定に従って、提案メールを作成してください。

# Context

Webデザイナー歴3年のフリーランス。ECサイト制作が専門で、直近の実績は

アパレルEC月商120万→210万(リニューアル後3ヶ月)。

新規クライアント候補は、地方の中小アパレルメーカーのEC事業部長(40代男性)。

先方の現サイトはモバイル未対応で、モバイル流入が68%あるのにCV率はPCの半分。

# Objective

初回提案メールを作成する。

先方が社内稟議に回せるレベルの根拠(数値・実績)を含める。

# Style

課題提起→数値根拠→提案→次のステップの4段構成。

箇条書きは3項目以内。全体で400字以内。

# Tone

プロフェッショナルかつ親しみやすい。

硬すぎる敬語は避け、体言止めを混ぜて軽やかに。

# Audience

40代のEC事業部長。技術には詳しくないが、売上・CVRの数字には敏感。

決裁権限は上司にあり、本人は稟議のための材料を集めている。

# Response

メール本文のみ。件名は別行に書く。署名は不要。

400字以内。

返ってきた文章:

件名:モバイルCV率2倍改善のご提案|貴社ECサイトリニューアル

○○様

初めてご連絡いたします。フリーランスWebデザイナーの△△です。

貴社サイトを拝見し、1点気になった点がございました。モバイル流入が全体の68%を占めているにもかかわらず、モバイル版のUI最適化が限定的。これがCV率のボトルネックになっている可能性が高いと考えます。

直近でご支援したアパレルEC様では、同様の課題に対しモバイルUI全面リニューアルを実施。月商120万円→210万円(3ヶ月)という結果が出ております。

貴社でも類似の改善余地があると見込んでおり、具体的な提案書を30分ほどのお打ち合わせでご説明できれば幸いです。

まずは来週中のご都合をいただければ、ご訪問いたします。

激変した。 冒頭から「モバイルCV率2倍改善」という数値提案で始まり、Audience に書いた「数字に敏感」が正確に反映されている。Style の4段構成も守られていて、体言止め(「可能性が高いと考えます」→「ボトルネックになっている可能性」)も効いている。400字という制約も厳密に守った。

ChatGPTにMarkdown見出しでCO-STARを渡すと、6要素が全部独立した指示として処理される。見出しレベル(# ##)がChatGPTにとって「ここからここまでが1ブロック」の明確なシグナルになっているからだ。

パターン3:CO-STAR + XMLタグ(Claude流)

同じ内容を <context> <objective> …のXMLタグで囲んで投げた結果:

返ってきた文章(冒頭抜粋):

○○様

初めまして。フリーランスのWebデザイナーの△△と申します。

貴社ECサイトを拝見いたしました。モバイル流入が68%を占める一方で、モバイルのCV率がPC比で半分という現状、改善余地が大きいと感じました。過去にご支援したアパレルECでは、月商120万円から210万円(3ヶ月)までの改善実績がございます。…

一見ちゃんとしているが、よく見るとパターン2より固い。 「体言止めで軽やかに」の指示が弱くなり、敬語の厚みが増している。Style の「400字以内」も404字でギリオーバー。

ChatGPTにとって <context> タグは「何かHTMLっぽい装飾」程度の扱いで、見出しほど強い構造情報にはならない。6要素は読めるが、Markdown見出しで渡したときほど「ブロックとして独立」していない。結果、指示の細部がぼやける。

3パターン比較まとめ

| パターン | 指示の反映度 | 制約遵守 | 体感 |

|---|---|---|---|

| 1. CO-STARなし | △ | × | テンプレ感満載。匿名的 |

| 2. CO-STAR + Markdown | ◎ | ◎ | 数値・制約・トーン全反映 |

| 3. CO-STAR + XMLタグ | ○ | △ | 6要素は読めるが細部がぼやける |

結論:ChatGPT × CO-STARの最適解は Markdown見出し形式。 XMLタグは Claude の専売だ、と Claude × CO-STARプロンプト術 でも書いた通り、ChatGPTにはMarkdownの方が刺さる。

ChatGPTでCO-STARを書くときのコツ5つ

実測結果から、ChatGPT向けCO-STARの書き方は5つに集約できる。

1. 見出しは # Context のMarkdown形式で統一する

# Context # Objective # Style # Tone # Audience # Response の6つ。## や ### でもいいが、同じレベルで揃えることが重要だ。レベルが揃っていないと、ChatGPTは「親子関係がある」と誤読することがある。全部トップレベルの # で並べておけば、6要素が対等のブロックとして読まれる。

2. 英語の見出しを使う

# Context を # 文脈 と日本語にしても読めるが、英語のほうが精度が安定する。CO-STARの原語も英語なので、英単語の見出しだとChatGPTが「これはあのフレームワークだな」と認識しやすい。トークン数も英語の方が少なくて済むので、長文のCO-STARを投げるときは特に効いてくる。

3. Styleには「禁止事項」を1つ入れる

ChatGPTは指示に忠実すぎるので、「やってほしくないこと」を明記しないと、勝手にやってくる。代表例が「冒頭で『はじめまして』テンプレを書いてくる」「最後に『いかがでしたでしょうか』で締める」など。Style に「いかがでしたでしょうか系の締めは禁止」「冒頭の定型挨拶は1行以内」と書くだけで、AI臭が抜ける。

4. Responseに文字数と段落数を両方書く

「400字以内」だけだと、ChatGPTはときどき400字オーバーする。「400字以内、段落は3つ以内」と字数と段落数をセットで制約すると、ほぼ正確に守る。制約が2つあると、ChatGPTは両方を満たす最小公倍数みたいな文章を組み立ててくるからだ。

5. Audienceには「知識レベル」と「関心事」を両方書く

「40代のEC事業部長」だけだと抽象的すぎる。「技術には詳しくないが、売上・CVRには敏感」と知識レベル(何を知らない)と関心事(何に食いつく)を両方書くと、ChatGPTはその2軸で全文のトーンを調整する。パターン2で「売上・CVR」の数字が自然に冒頭に出てきたのは、Audience にこの2軸が書かれていたからだ。

この5つを押さえれば、ChatGPTのCO-STAR出力は90点以上で安定する。残り10点はClaudeの領域(体温・遊び・微妙なニュアンス)で、そこは別のAIで埋めるのが効率的だ。

Claude vs ChatGPT ― CO-STARが返してくる”顔”の違い

両者に同じCO-STARを渡したときの出力の違いを、一覧で整理する。実際にClaude × CO-STARの記事の実測データと並べてみると、それぞれの”顔”が見えてくる。

| 観点 | ChatGPT(GPT-4o) | Claude(3.5 Sonnet) |

|---|---|---|

| 最適フォーマット | Markdown見出し(# Context) | XMLタグ(<context>) |

| 指示への忠実さ | ◎(ど真ん中を狙い撃ち) | ○(中心から少し広げて解釈) |

| 文字数制約 | ◎(厳密に守る) | ○(多少オーバーすることあり) |

| トーンの機微 | △(指示された中点) | ◎(ニュアンスを足してくる) |

| 禁止事項の遵守 | ◎(明記すれば完全遵守) | ○(稀に破る) |

| 冒険性・創造性 | × | ◎ |

| 一次情報の取り込み | ○ | ◎ |

この表を見ると一目瞭然だが、ChatGPTは「制約遵守・安定性」、Claudeは「表現の幅・機微」という棲み分けになっている。

チェーン店とバル、と最初に言った比喩の通りだ。チェーン店の強みは「全国どこでも同じ味」の再現性、バルの強みは「今日の気分に合わせてくれる」柔軟性。どちらが上でも下でもない。頼む側が何を求めているかで選ぶだけだ。

使い分け指針 ― どっちに何を頼むか

では実務では、どういうタスクをChatGPTに振り、どういうタスクをClaudeに振るべきか。自分の実運用で使っている分担表を公開する。

ChatGPTに向いているタスク(チェーン店向き)

- 大量に同じフォーマットで書き出すもの — ブログ記事のタグ一覧、商品説明文、メールテンプレ量産

- 数値・データの整形 — 表形式の要約、CSV化、JSON化

- 指示の細かい翻訳・リライト — 「この文章を300字以内で、体言止め禁止、ビジネス敬語で」みたいな制約型タスク

- 反復作業のプロンプト化 — 毎週やる定型業務。再現性が命

- コード生成(定型パターン) — 既存のパターンを流用するコード(REST API エンドポイント量産など)

Claudeに向いているタスク(バル向き)

- 文章の体温を上げるリライト — テンプレ調をkiotokiスタイルっぽく変換するとか

- 企画の発想・フレーミング — 同じネタを何通りの切り口で書けるか、のブレスト

- 長文の一次解釈・要約 — PDFレポートを読ませて「面白かったところ」を抽出する

- XMLタグを使った精密な指示 — Claude × CO-STARで詳述した XMLタグ+CO-STARの掛け合わせ

- コード生成(探索的) — まだパターンが決まっていない機能の初期実装

CO-STARの使い分けまとめ

| フェーズ | 使うAI | フォーマット |

|---|---|---|

| ラフ案・アイデア出し | Claude | XMLタグ+CO-STAR |

| 量産・定型化 | ChatGPT | Markdown+CO-STAR |

| 最終リライト・体温調整 | Claude | XMLタグ+CO-STAR |

| 数値レポート・表整形 | ChatGPT | Markdown+CO-STAR |

つまり、ChatGPTとClaudeは競合じゃなくて分業相手だ。CO-STARという共通フォーマットを両方に使い回すことで、プロンプトの資産は1本に集約できる。これが CO-STAR が「プロンプトフレームワークの標準化」として優秀な所以だ。5つのフレームワークを比較したプロンプトフレームワーク比較記事でも、CO-STARが「両AI対応で最もコスパが良い」と結論付けた理由がここにある。

よくある質問(FAQ)

Q: ChatGPTでXMLタグを使うのは完全に無意味?

無意味ではないが、Markdown見出しほど効かない。 長文プロンプトで「参考資料」セクションを明確に仕切りたいときなど、限定用途なら使える。ただしCO-STARの6要素を囲む目的なら、Markdown見出しの方が常に精度が高い。

Q: CO-STARの順番は C→O→S→T→A→R じゃないとダメ?

どの順番でもOK。 ChatGPTは見出しの内容で要素を判別するので、順番は関係ない。ただしC→O→S→T→A→Rで統一しておくと、自分で見返すときに探しやすい。

Q: GPT-4o以外のモデル(GPT-4, GPT-3.5)でも同じ結果?

基本的には同じ傾向だが、GPT-3.5は制約遵守が弱い。 「400字以内」と書いても500字出してくることがある。実運用でCO-STARを使うならGPT-4o以上を推奨する。GPT-4(非o)はGPT-4oとほぼ同等。

Q: 6要素すべて埋めないとダメ?

不要な要素は省略していい。 たとえば「日付の文字列を整形して」だけなら Tone も Audience も要らない。CO-STARはフル装備であって、必須装備ではない。CO-STARフレームワーク完全ガイドでも詳述した通り、案件に応じて3〜4要素で十分効く。

Q: ChatGPTで実務ですぐ試したい。サンプルプロンプトはある?

CO-STAR実践テンプレート集に、フリーランスの実務10シーン分のCO-STARテンプレートを用意した。コピペしてそのまま使える。ChatGPT版とClaude版で出力が変わるシーンの使い分けも記載している。

まとめ ― ChatGPTはチェーン店。番号で頼めば間違わない

ChatGPTにCO-STARは効く。ただしXMLタグではなくMarkdown見出しで、書き忘れた要素は出てこない前提で、禁止事項まで明記して、字数と段落数を両方制約して、Audienceに知識レベルと関心事を両方書く。この5点を押さえれば、ChatGPT × CO-STARは90点以上で安定する。

そして、そこから先の10点――文章の体温、微妙なニュアンス、冒険的な言い回し――は、Claudeに頼む。Claudeに渡すときはXMLタグで仕切る。これが両AIを同時に使いこなす最短ルートだ。

ChatGPTはチェーン店、Claudeはこだわりバル。どちらが上でもない。ただし頼み方を間違えると、両方の実力を半分も引き出せない。CO-STARという共通メニューをベースに、店の種類で渡し方だけ変える。これさえ覚えておけば、AI選びで迷う時間は消える。

プロンプトフレームワークの基礎から入りたい人は CO-STARフレームワーク完全ガイド へ。他のフレームワーク(RACE / RISEN / APE / CoT)とCO-STARを比較したい人は プロンプトフレームワーク比較記事 へ。Claude側の使いこなしは Claude × CO-STARプロンプト術 に書いた。実務ですぐ動きたい人は CO-STAR実践テンプレート集 のコピペ発注書10本が早い。

メニュー番号を覚えたら、あとは店を選ぶだけだ。